立即生成 AI 视频与图像

Kling、Veo、Seedream、GPT Image 等模型都可直接从首页调用。输入提示词或上传参考图片,即可在几分钟内得到结果。

此图片将作为视频的起始帧

0 / 5000

什么是 Happy Oyster AI?

Happy Oyster AI 是一个用于实时世界创建与交互的开放式世界模型。它建立在原生多模态架构之上,支持文本、语音和图像输入,并可联合生成音频与视频,输出连续且符合物理规律的环境,在整个会话中保持光照、重力、物体位置与角色运动的一致性。与传统 AI 视频工具一次提示、一次成片的单次工作流不同,Happy Oyster 会在生成过程中持续接收并响应指令,世界会随着你的引导实时演化。在开发者和创作者社区中,它也常被写作 happyoyster,代表着从被动视频生成走向主动世界模拟的一次跃迁。

Happy Oyster 拥有两种模式。Directing Mode 更像一个实时导演工作室:用户可以在最长 3 分钟、480p 或 720p 的生成过程中随时输入文本、语音或图像指令,切换镜头、改写角色行为或直接重塑叙事,而且不需要重新开始。世界会立刻响应,并从当前状态继续运行。Wandering Mode 则让用户以第一人称进入生成环境,通过 WASD 和镜头控制在最长 1 分钟、480p 的世界中自由探索。随着移动,世界会程序化扩展,同时始终保持稳定的物体布局、空间物理和环境连续性。

Happy Oyster 背后的团队此前发布过 HappyHorse,并在 Happy Oyster 于 2026 年 4 月 16 日亮相前拿下全球文生视频基准领先成绩,这标志着创作范式正从片段生成转向实时、可交互的世界模拟。它面向的应用包括实时影视前期预演、游戏世界原型设计,以及由观众选择推动走向的互动叙事。本平台也沿着这一方向构建,在 Happy Oyster 世界模型即将到来之际,先提供由 Kling、Veo、Seedream、GPT Image 等驱动的视频、图像与音频生成工具。

本平台上的 AI 引擎

视频、图像与音频模型集中在一个账号体系中,每个引擎都针对特定创作任务优化。

Happy Oyster AI

视频Happy Oyster AI 是一个开放式世界模型,可实时生成连续、可交互的 3D 环境。Directing Mode 通过多模态输入引导最长 3 分钟的场景发展;Wandering Mode 则提供在程序化扩展世界中的第一人称探索体验。整个会话中,光照、运动与空间结构都会保持符合物理规律的一致性。这个世界模型即将到来。

Kling

视频快手的视频引擎,基于 3D VAE 空间建模,在同一条链路中协同生成视频与音频,可同时输出对白、音效和背景音乐。支持文生视频、图生视频、最长 15 秒的多镜头序列、Motion Control 角色动作迁移,以及 AI Avatar 口型同步视频。

Veo

视频Google DeepMind 的电影级视频生成器,可输出广播级画质的 8 秒片段,并内置 AI 音频,无需后期即可获得同步声音。在电影化场景构图与环境真实感方面表现突出,同时支持首尾帧控制与参考风格视频生成。

GPT Image

图片OpenAI 的图像模型,在 LMArena、Design Arena 和 Artificial Analysis Image Arena 这三个独立基准上都拿到文字渲染准确性第一。凡是涉及标识、排版或品牌图形可读性的提示词,它都是优先选择。

Flux Pro

图片Black Forest Labs 的生产级图像引擎,在多项对比测试中保持领先胜率,支持 1K 和 2K 输出以及七种宽高比。它尤其适合重视吞吐量的工作流,例如产品素材批量生成、社交内容生产与快速迭代。

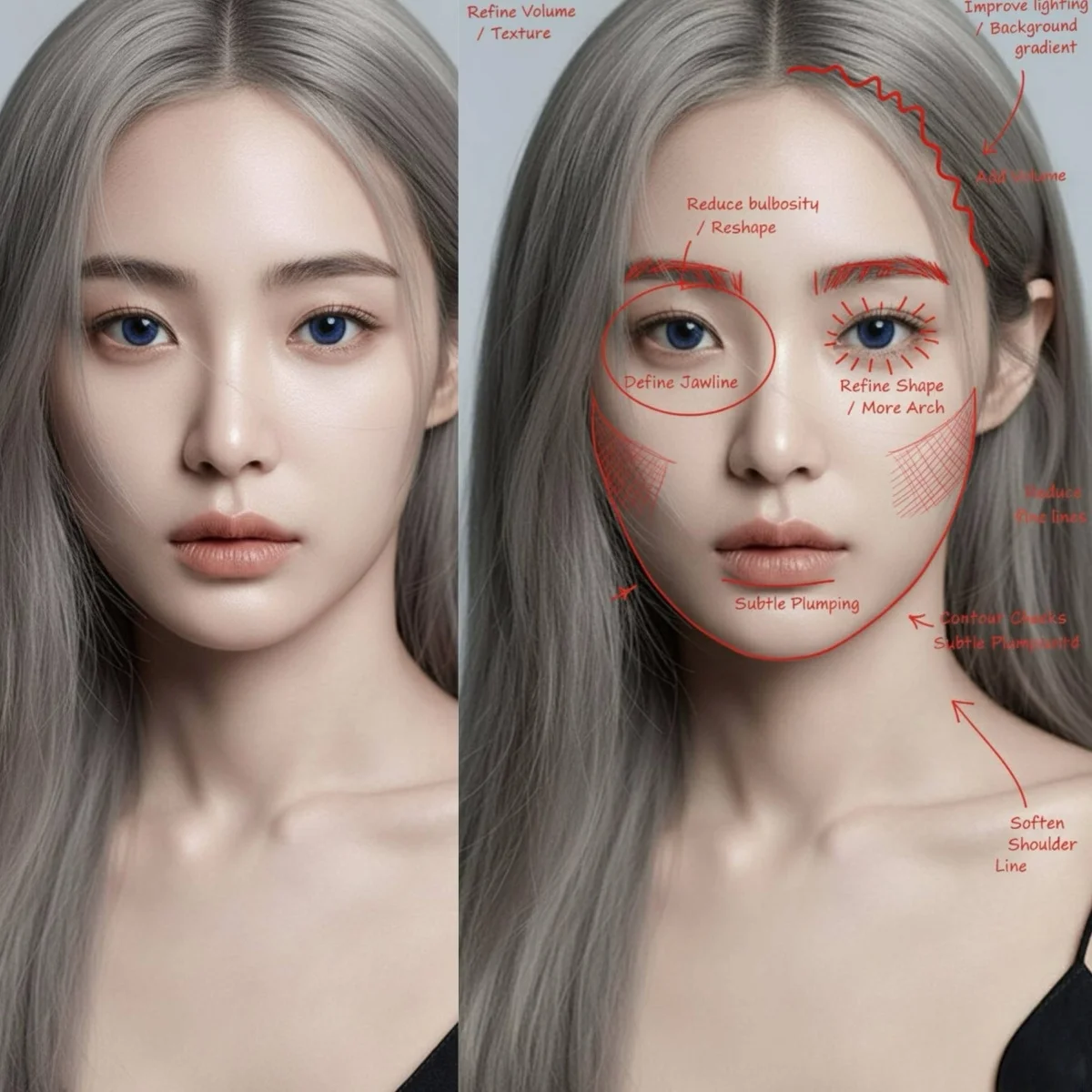

Nano Banana

图片Google 的角色一致性图像引擎,在文生图模式下最多可使用 8 张参考图,锁定人物面部、发型、服装与品牌元素在整组生成中的稳定性。Nano Banana 2 进一步支持 Google Search grounding、14 张参考图以及 15 种宽高比。

Seedream

图片字节跳动的原生 4K 图像引擎,最高支持 4096×4096 像素,覆盖包括 21:9 超宽幅在内的八种宽高比。Seedream 5 Lite 还加入了思维链视觉推理,适合处理空间关系复杂、多人同场或构图要求精确的画面。

Runway Gen-4

视频Runway 的 Gen-4 Aleph,用于 AI 视频编辑。它可以通过文字提示修改已有视频,在保留原始运动路径的同时完成风格迁移、物体改造和场景变化,并支持多种宽高比与专业级输出质量。

覆盖多种创作格式的 AI 工具

视频、图像、动作与音频,多个 AI 引擎整合在同一平台中,分别针对不同创作任务和输出要求优化。

AI 视频生成

Happy Oyster AI 在单次生成中同步输出视频与声音,无需独立配音步骤。Kling 3.0 原生 4K 双语音频,Veo 3.1 提供 48kHz 空间立体声,适合电影级创作。免费开始。

创建视频AI 图像生成

GPT Image 2 和 GPT Image 1.5 精准渲染文字图形,Seedream 4.5 原生 4K 场景,Flux 2 Pro 高速批量生产,Nano Banana Pro 保持角色跨图一致性。一个工作台,满足所有创作任务,免费使用,无水印。

创建图片为什么在 Happy Oyster AI 上创作

这是一个围绕世界模型愿景构建的平台,同时把创作者今天就能使用的 AI 视频、图像与音频工具整合在一起。

围绕世界模型愿景构建

Happy Oyster AI 为 AI 生成内容定义了新的方向:不再只是单个片段,而是持续存在、可实时响应的环境。本平台上的工具也沿着这个方向组织,强调符合物理规律的视频引擎、角色动画系统,以及面向场景与世界而非单帧思考的多模态工作流。

每一帧都保持空间一致性

Kling 的 3D VAE 架构会在生成过程中逐帧建模物体深度、表面物理与光照关系,而不是事后补偿。物体位置更稳定,光线变化更自然,运动也更符合物理逻辑。它是当前商业视频引擎中,最接近世界模型空间一致性标准的一类能力。

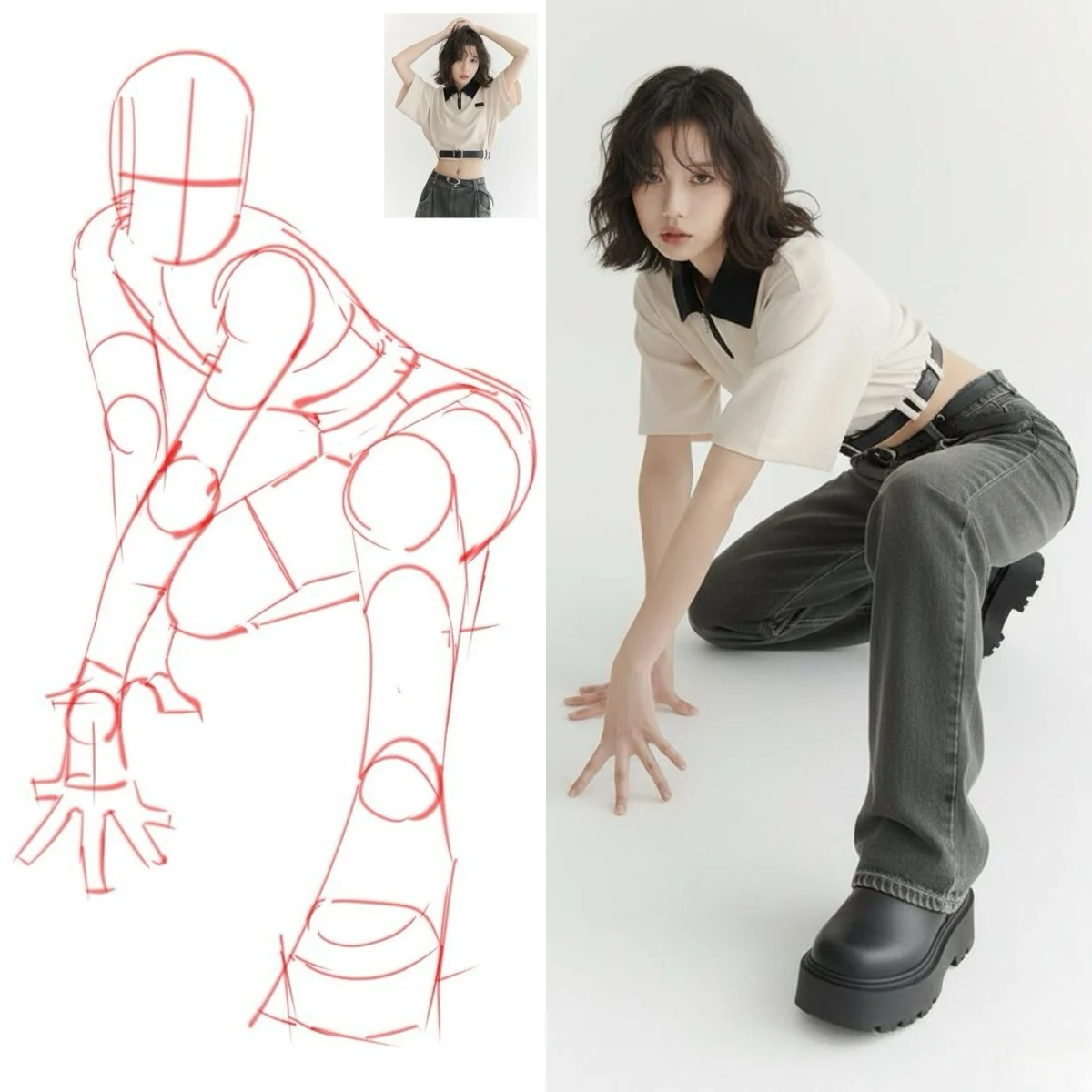

角色控制精确到帧级

Motion Control 可将参考视频中的动作迁移到角色图片上,实现全身同步,精确捕捉关节位置、重心变化和细微手势,甚至细到手指层面。无论是舞蹈编排、手语、武术,还是表演片段,都能通过一段参考视频和一张角色图片完成生成。

一个账号,用齐主流引擎

Veo 3.1 负责电影级输出与内置 AI 音频,Kling 3.0 擅长原生带声视频和动作控制,Wan 提供高清图生视频,Runway Gen-4 Aleph 用于 AI 视频编辑,GPT Image 处理高精度文字图形,Seedream 4.5 提供原生 4K,Flux 2 Pro 强调批量生成速度。你可以在同一条提示词上对比多个结果,选择最适合交付的版本。

立即生成,无需额外设备

无需 GPU、无需安装软件、无需动作捕捉设备,也不需要渲染农场。打开平台,输入提示词或上传参考素材即可开始生成。付费方案下可获得无水印输出与商业授权,适用于社交媒体、广告、产品内容、影视前期预演和客户交付。

如何创建 AI 视频与图像

从提示词到成品只需三步,无需技术背景,也无需额外硬件。

编写提示词或上传参考素材

用自然语言描述你想创建的场景,包括环境、主体、氛围与运动方式。对于图生视频或动作控制工作流,可以上传静态图片或参考视频。同一界面即可处理文生视频、图生视频、文生图与图生图。

为任务选择合适的 AI 引擎

从 Kling、Veo、Wan、Runway、GPT Image、Seedream、Flux 等模型中选择最适合当前需求的引擎。不同模型分别针对原生音频协同生成、4K 分辨率、电影质感、批量速度或角色一致性优化,你只需要根据目标输出选择合适的那个。

下载并投入商用

根据模型和分辨率不同,生成过程通常只需几秒到几分钟。付费方案可获得无水印输出与完整商业授权,可直接用于社交媒体、广告、影视前期预演、产品内容和客户交付。

Happy Oyster AI 常见问题

关于世界模型、平台工具以及如何开始使用的完整说明。